Processamento de Linguagem Natural com BERT e Python

Loại khoá học: Data Science

Aplique o algoritmo revolucionário de PLN e Deep Learning do Google para tarefas do mundo real! Crie um sistema de Q&A

Mô tả

A área de Processamento de Linguagem Natural - PLN (Natural Language Processing - NLP) é uma subárea da Inteligência Artificial que tem como objetivo tornar os computadores capazes de entender a linguagem humana, tanto escrita quanto falada. Alguns exemplo de aplicações práticas são: tradutores entre idiomas, tradução de texto para fala ou fala para texto, chatbots, sistemas automáticos de perguntas e respostas, sumarização de textos, geração automática de descrições para imagens, adição de legendas em vídeos, classificação de sentimentos em frases, dentre várias outras!

Dentro do contexto de Processamento de Linguagem Natural, a arquitetura BERT (Bidirectional Encoder Representations from Transformers) tem ganhado muita atenção dos desenvolvedores e atualmente é considerada como o modelo de Machine Learning mais eficiente nessa área! Muitos pesquisadores a consideram como um marco na área de PLN, mudando um pouco o paradigma de como as aplicações são implementadas.

Atualmente, o setor de Inteligência Artificial está cada vez mais necessitando de soluções de Processamento de Linguagem Natural, ou seja, aprender essa área juntamente com a arquitetura BERT pode ser a chave para trazer soluções reais para necessidades presentes e futuras. Baseado nisso, este curso foi projetado para quem deseja crescer ou iniciar uma nova carreira na área de Processamento de Linguagem Natural, obtendo uma sólida experiência nessa área utilizando modernas técnicas de Deep Learning e Redes Neurais Artificiais!

Aproveitaremos a enorme quantidade de dados de texto disponíveis on-line (duas bases de dados reais) e exploraremos duas das principais técnicas de PLN, o que lhe dará o poder necessário para enfrentar com êxito qualquer desafio do mundo real! Além de aprender a teoria, você também desenvolverá três estudos de caso:

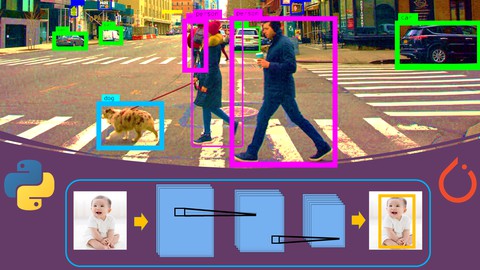

Criação de um classificador de sentimentos utilizando dados do Twitter e a integração de um tokenizador BERT com Redes Neurais Convolucionais

O segundo estudo de caso é semelhante ao primeiro, porém, utilizaremos a camada de embedding do BERT para integração com uma Rede Neural Convolucional para classificar sentimentos

Criação de um sistema de perguntas e respostas (Q&A - Questions and Answers) utilizando o BERT! A ideia é fazer uma pergunta sobre um determinado texto e o algoritmo vai indicar onde está a resposta para a nossa pergunta, muito similar com o que ocorre nos fóruns de pesquisa

Utilizaremos tecnologias modernas, como a linguagem Python, o TensorFlow 2.0 e o Google Colab, garantindo que você não tenha problemas com instalações ou configurações de softwares na sua máquina local.

Bạn sẽ học được gì

Crie um sistema de perguntas e respostas (Q&A) que pode ser utilizado em fóruns de pesquisas

Ligue o BERT à uma Rede Neural Convolucional especializada em Processamento de Linguagem Natural para classificação de sentimentos

Entenda a história do BERT e por que ele mudou a área de Processamento de Linguagem Natural (PLN)

Use as ferramentas de tokenização fornecidas com o BERT para pré-processar textos com eficiência

Use a camada BERT como incorporação para conectá-la ao seu próprio modelo de Processamento de Linguagem Natural (PLN)

Use o BERT como um modelo pré-treinado e depois ajuste-o para obter melhores resultados

Obtenha modelos disponíveis no Tensorflow Hub, a plataforma onde você pode obter modelos já treinados

Use o Google Colab e o Tensorflow 2.0 para suas implementações de IA

Yêu cầu

- Lógica de programação, principalmente estruturas condicionais e de repetição

- Básico da linguagem Python

- Orientação a objetos

- É desejável que você já tenha tido algum contato com a API Keras do TensorFlow

Nội dung khoá học

Viết Bình Luận

Khoá học liên quan

Đăng ký get khoá học Udemy - Unica - Gitiho giá chỉ 50k!

Get khoá học giá rẻ ngay trước khi bị fix.

Đánh giá của học viên

Bình luận khách hàng